Sua Jornada em IA Começa Aqui: O Desafio do Treinamento

Imagine que você quer ensinar um computador a diferenciar fotos de cães e gatos. Uma abordagem seria mostrar a ele milhões de imagens, para que ele aprendesse do zero o que é um olho, um focinho, um pelo. Esse processo, chamado de treinamento do zero, exige uma quantidade massiva de dados, um poder computacional gigantesco e muito, mas muito tempo. Para quem está começando em Inteligência Artificial, isso pode ser desanimador. Mas e se houvesse um atalho?

É aqui que entra o Transfer Learning, ou Aprendizagem por Transferência. Em vez de começar do zero, nós pegamos o "cérebro" de uma IA que já é especialista em uma tarefa ampla (como reconhecer milhares de objetos em imagens) e o adaptamos para a nossa tarefa específica (diferenciar cães de gatos). É como contratar um fotógrafo profissional para identificar animais, em vez de ensinar um bebê a reconhecer formas primeiro.

O que é Transfer Learning, afinal?

Pense em aprender a dirigir um caminhão. Você não precisa reaprender o que é um volante, um acelerador ou um freio. Você já aprendeu esses conceitos básicos quando tirou sua carteira para dirigir um carro. Você apenas transfere esse conhecimento e foca nas novas habilidades: as marchas diferentes, o tamanho do veículo e como fazer curvas mais abertas.

O Transfer Learning é exatamente isso. Ele aproveita um modelo pré-treinado, que já aprendeu a identificar características gerais e complexas de dados (como bordas, texturas e formas em imagens, ou estruturas gramaticais em textos), e reutiliza esse conhecimento para uma nova tarefa. Nós basicamente damos um "empurrão inicial" gigantesco para o nosso novo modelo.

Como o Transfer Learning Funciona na Prática?

O processo geralmente segue três passos simples, especialmente em áreas como Visão Computacional.

Etapa 1: Escolha um Modelo Pré-treinado

Primeiro, você escolhe um modelo de ponta que foi treinado em um conjunto de dados enorme e genérico. Para imagens, modelos como o VGG16, ResNet ou MobileNet, que foram treinados no dataset ImageNet (com mais de 14 milhões de imagens), são escolhas populares. Eles já são especialistas em identificar características visuais.

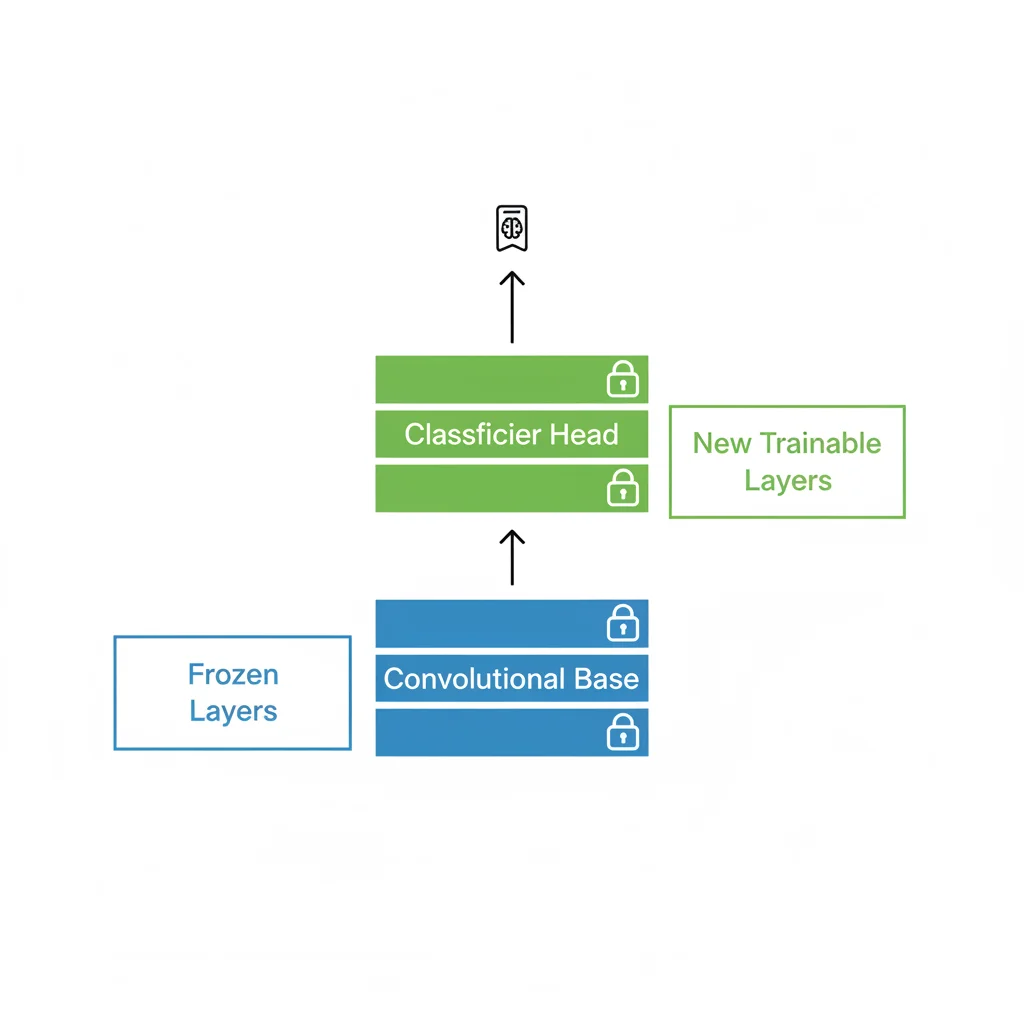

Etapa 2: Congele as Camadas Iniciais

Um modelo de Deep Learning é composto por várias camadas. As primeiras camadas aprendem características muito genéricas (linhas, cores), enquanto as últimas aprendem coisas mais específicas. No Transfer Learning, nós "congelamos" as camadas iniciais. Isso significa que seus pesos (o conhecimento aprendido) não serão alterados durante o nosso novo treinamento. Estamos essencialmente dizendo: "Ei, essa parte do cérebro já é ótima, não precisa mudar nada".

Etapa 3: Adicione Novas Camadas e Treine

Depois de congelar a base, removemos a camada de saída original (que classificava 1000 objetos, por exemplo) e adicionamos nossas próprias camadas no topo. Essas novas camadas, chamadas de "cabeça" (head), são as únicas que serão treinadas com nossos dados específicos (fotos de cães e gatos). Como a maior parte do modelo já está pronta, o treinamento é incrivelmente mais rápido e exige muito menos dados.

Vantagens Incríveis da Aprendizagem por Transferência

- Menor Necessidade de Dados: Você não precisa de um dataset com milhões de exemplos. Muitas vezes, algumas centenas ou milhares de imagens são suficientes.

- Treinamento Mais Rápido: Como a maior parte do modelo está congelada, o processo de treinamento é drasticamente mais veloz.

- Melhor Performance: Modelos pré-treinados já possuem um conhecimento robusto do mundo, o que geralmente leva a uma precisão maior e resultados mais confiáveis.

Exemplo de Código: Classificando Imagens com Keras

Veja como é simples carregar um modelo pré-treinado e adaptá-lo usando a biblioteca Keras com TensorFlow.

# Importando as bibliotecas necessárias

import tensorflow as tf

from tensorflow import keras

# Carregando o modelo VGG16 pré-treinado no ImageNet, sem incluir a camada de saída

base_model = keras.applications.VGG16(

weights='imagenet',

include_top=False, # Não incluir a camada de classificação para 1000 classes

input_shape=(150, 150, 3)

)

# Congelando as camadas da base. Elas não serão treinadas.

base_model.trainable = False

# Criando nosso novo modelo em cima da base

inputs = keras.Input(shape=(150, 150, 3))

x = base_model(inputs, training=False)

x = keras.layers.GlobalAveragePooling2D()(x)

# Adicionando nossa camada de saída para 2 classes (cão e gato)

outputs = keras.layers.Dense(1, activation='sigmoid')(x)

model = keras.Model(inputs, outputs)

# Agora podemos compilar e treinar este modelo com nossos poucos dados!

model.summary()

Conclusão: Seu Próximo Superpoder em IA

O Transfer Learning não é apenas uma técnica; é uma mudança de paradigma que democratizou o acesso à Inteligência Artificial de alta performance. Ele permite que desenvolvedores, estudantes e pequenas empresas criem soluções sofisticadas sem a necessidade de recursos computacionais de gigantes da tecnologia. Da próxima vez que você pensar em um projeto de IA, lembre-se: você não precisa começar do zero. Você pode se apoiar nos ombros de gigantes.

0 Comentários